編輯導讀:從 2015 年特斯拉(Tesla, TSLA-US)開放 Autopilot 軟體功能以來,大貨車 一直是 Autopilot 的噩夢, 特斯拉 自駕 技術 不斷爆出車禍事故,顯然的,特斯拉的攝像頭很可能無法判斷 大貨車 是不是一輛車。為什麽會這樣?這篇文章有許多專家為我們提出了質疑與解釋,來看看作者的精彩論點:

從 2015 年特斯拉(Tesla, TSLA-US)開放 Autopilot 軟體功能以來,大貨車一直是 Autopilot 的噩夢。看看以下這些事故,都是在 Autopilot 開啟模式下造成的:

2016 年 5 月,Model S 車主與大貨車相撞死亡

2016 年 5 月,Model S 車主 Joshua Brown 在 Autopilot 開啟狀態下,與一輛橫穿馬路的大貨車相撞,Joshua Brown 在事故中死亡。

2019 年 3 月,Model 3 上了一台白色拖掛卡車死亡

2019 年 3 月,一輛 Model 3 在美國佛羅里達州開啟Autopilot 時撞上了一台白色拖掛卡車,駕駛員不幸身亡。

2020 年 6 月初, Model 3 在嘉義撞向一輛大貨車

今年 6 月初,在嘉義縣的中山高速公路上,一輛 Model 3 也在 Autopilot 開啟狀態下撞向了一輛大貨車。當時大貨車並不是在行駛中,而是側翻在路面。

2020 年 6 月,Model 3 與撞大貨車碰撞

6 月 24 日下午,在深圳南坪一段道路上,一輛開啟了Autopilot 功能的 Model 3 ,與一輛並線的大貨車發生碰撞。事故發生時,大貨車正從Model 3 車輛右前方并線進入本車道,Autopilot 沒有減速,Model 3 車主事後回饋:在前車并線時 Autopilot 反倒加速撞向了大貨車。

事故判定結果:大貨車全責

在 6 月底的事故發生後,當事的特斯拉 Model 3 車主劉先生在多個渠道提出了對特斯拉Autopilot 的質疑。這也是今天不少特斯拉車主和準車主們想弄清楚的問題——Autopilot 在這次或者這類交通事故中究竟是否存在問題?

簡單還原一下 6 月位於深圳的這次事故:

24 日下午三時左右,天氣晴朗,車主劉先生駕駛著Model 3 上了深圳南坪快速路。和往常一樣,他開啟了特斯拉Autopilot。在ACC(自適應巡航)模式下,Model 3 跟在一輛黃色大貨車後行駛。這是一條他平時上下班常走的路線,以往使用Autopilot 時,系統基本上可以順利完成自動跟車等駕駛任務,所以他也習慣了將一隻手搭在方向盤上。

不過這次,Autopilot 給了他一場驚嚇。

就在行駛到一段虛線路段時,Model 3 右前方的車道上大貨車開啟轉向燈,並向 Model 3 車道突然并線。根據 Model 3 車身攝像頭拍攝的影片畫面顯示,在大貨車并線向本車道行駛時,特斯拉依然向前行駛。幾秒後,Model 3 撞上了大貨車。

事故責任很快釐清。從現場照片看,大貨車變道時沒有避讓相鄰車道的車輛,碰撞事故發生時大貨車車身壓在了道路虛線上。保險公司認定為大貨車全責。雖然事故是由大貨車造成的,但當事的Model 3 車主的質疑是:

為什麼在大貨車并線進入本車道時,Model 3 沒有採取減速或製動的避讓措施?Autopilot 是不是根本沒有識別到砂石車?在快要撞上大貨車時,為什麼 Model 3 還要加速向前衝上去,導致車主沒有充足的時間順利接管車輛?

核心爭議:Autopilot 是否「失職」?

在最近的一次溝通中,特斯拉官方對這場事故做了結論:特斯拉華南區總經理向當事 Model 3 車主表示,特斯拉的產品沒有問題。至於 FSD 為什麼會撞上貨車,官方解釋是:「因為路況復雜,駕駛員手沒放在方向盤上,沒有及時接管。當時所有自動駕駛硬體均正常工作,後台數據沒有異常。」

「駕駛員的手沒有放在方向盤上」,這點是特斯拉從後台調取數據後做出的判斷。而車主告訴汽車之心,他的手一直握著方向盤,只是不會一直對方向盤施加壓力。有自動駕駛領域的業內人士認為,「感應方向盤太容易被鑽漏洞,屬於明顯的漏洞。自動駕駛還是得依靠系統功能安全性,而不是限制駕駛員。」

截止到發稿前,此次交通事故的車主仍在就 Autopilot 是否存在問題與特斯拉溝通。實際上,從影片中的事故情況看,如果換成人類駕駛員駕駛,只要看到了大貨車進行并線,幾乎一定會做出減速或者制動的反應。

但Autopilot 顯然沒有做到這一點。

那麼,特斯拉Autopilot 是否真的存在問題?

Autopilot 對加塞行為的判斷邏輯首先在感知層面,特斯拉是否識別到了大貨車?廣汽研究院智能駕駛技術部部長郭繼舜分享了他此前對特斯拉進行測試的一些經驗。

他認為,特斯拉 Autopilot 識別超車的邏輯,是需要前車車身或車尾的二分之一進入本車道時,系統才會認為是這是一次超車。這樣進行超車意圖判斷的邏輯,是為了避免誤觸發,因為相鄰車道的車輛可能僅僅是部分貼近車道線行駛,但並沒有真正做出加塞動作。

因此,特斯拉會針對相鄰車道的超車意圖設定一個具體的閾值。車身或車尾的二分之一,也是業界在加塞場景中其中一個採用較多的閾值。而且Autopilot 在功能開發上做了更多的工作:

如果特斯拉檢測到相鄰車輛的三分之一進入本車道,但還沒有達到超車的閾值,這時特斯拉在本車道內有時不會減速,而是向另外一側進行小幅避讓。根據事故當時的影片畫面,在這次交通事故中,大貨車大約有六分之一進入了特斯拉的車道,這麼近的距離還要進入加塞,本身就是大貨車的全責。

至於特斯拉是否識別到了大貨車,郭繼舜認為,在此次交通事故中,特斯拉側面主要依靠攝像頭來進行識別,而攝像頭只能夠看到大貨車的局部特徵。

也就是說,特斯拉的攝像頭很可能無法判斷大貨車是不是一輛車。

退一步說,即使特斯拉通過局部特徵判斷那是一輛大貨車,也無法做出對方將進行超車的判斷。因為大貨車加塞進入特斯拉車道的比例沒有達到 Autopilot 設定的加塞行為判斷的閾值。

第二個問題是,為什麼Model 3 會突然加速撞車?

目前可以明確的是,根據特斯拉的後台數據記錄,當事車主在整個事故過程中沒有踩下加速踏板,也就是說,加速屬於特斯拉Autopilot 控制下的行為。當時,特斯拉處於ACC 自適應巡航模式下,Autopilot 會追踪前方車輛進行自動跟車。因此,發生此次撞車事故有兩種可能:

- 特斯拉無法識別正在并線的大貨車,在發現前方ACC 的目標駛離後,車輛採取了加速跟車,從而發生撞車事故。

- 特斯拉識別到了大貨車,但Autopilot 認為沒有加塞的可能性,於是繼續自動跟車,導致撞車事故。

從算法邏輯上講,特斯拉 Aupilot 並沒有做錯什麼,不過,也有業內人士持不同觀點。

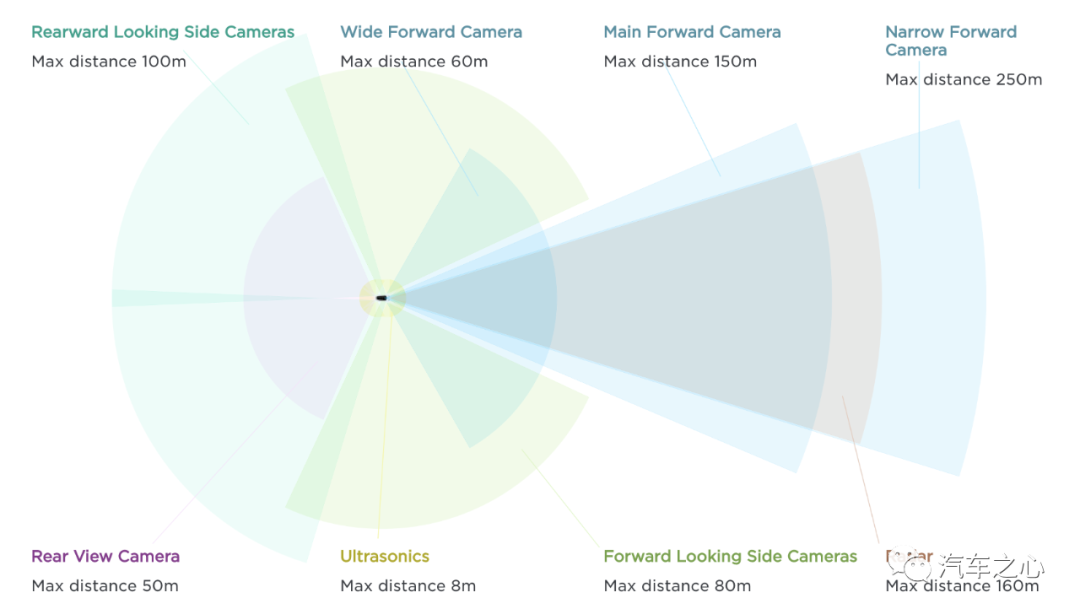

一位國內自動駕駛公司技術工程師解釋:「特斯拉的超聲波雷達可以檢測 8 到 12 米之間,基本上可以覆蓋一個半車道。在這次事故中,大貨車的車輪駛進車道時,超聲波肯定是能夠檢測到,但由於大貨車底盤高,車輪經過時系統會認為有障礙物。車輪通過後,又會認為沒有障礙物,系統可能過濾掉了超聲波雷達的檢測結果。Autopilot 的算法策略是重攝像頭輕毫米波雷達,感知融合有可能沒有開發得特別完善。最終,在算法層面,由於感測器融合檢測缺陷,特斯拉肯定沒有識別到大貨車。」

屢撞大貨車的背後

特斯拉已經不止一次撞上大貨車。今年 6 月,一輛 Model 3 在台灣嘉義縣中山高速上撞上一輛大貨車。事發時,內側車道上有一輛貨車發生側翻,後方駛來的Model 3 直接撞上貨車。在這次事故中,Model 3 開啟了Autopilot 功能,時速約為 110 公里。事後車主回憶,當時並未註意到前方車輛側翻,而是在車輛撞擊前 2 秒才進行了緊急制動。

2019 年 3 月,一輛Model 3 在美國佛羅里達州開啟Autopilot 時撞上了一台白色拖掛卡車,駕駛員不幸身亡。

2016 年 5 月,同樣在佛羅里達,一輛Model S 在Autopilot 模式下撞上一台白色大貨車。當時,白色大貨車正在調頭轉彎,特斯拉與大貨車側面發生碰撞,並從卡車底部鑽過,整個車頂被徹底「削掉」,駕駛員 Joshua Brown 身亡。

這一系列事故背後,Autopilot 怎麼了?不能識別大貨車嗎?

Autopilot 的感測器主要由 8 個攝像頭、 12 個超聲波感測器和 1 個增強版毫米波雷達組成。

對於這套方案,法雷奧中國CTO 顧劍民認為,「對攝像頭來說,需要用機器學習來訓練識別物體。但靜態物體類別多,形態也千差萬別,沒經過樣本訓練便識別不了。」

這裡的邏輯是,自動駕駛公司在開發視覺感知時,基本上採用深度學習技術,這項技術具備遷移和泛化特點。比如,讓系統看到一匹白色的馬,下次再看到一匹黑色的馬,系統仍然可以判斷出來那是一匹馬。但如果出現一隻豬,系統就無法識別,因為沒有學習過。車輛的視覺檢測與之類似。

以發生在台灣的交通事故為例,翻倒的大貨車場景,是特斯拉從來沒有見過的,根本檢測不出來是一輛車,系統可能把大貨車當成了天空。

所有的視覺檢測任務,首先要有完整的場景需求,然後根據場景需求進行算法設計,而算法都是有局限性和邊界的。這便是特斯拉Autopilot 和許多自動駕駛視覺檢測方案的天然缺陷。這種缺陷體現到大貨車的視覺檢測上,便暴露得更加明顯。

大貨車視覺檢測是全世界公認的難題

如今,大貨車視覺檢測是全世界公認的難題,尤其是近距離大貨車視覺檢測。這是因為,大車的異型車輛種類非常多,小車無非是換下顏色,或者車體結構存在如 SUV 和小轎車等的區別。但大車種類豐富,主要有拖掛車、平板車、水泥罐車等,再加上這些大貨車在實際駕駛場景中出現的頻率相比小車來說要低很多,想要收集數據並進行訓練相對困難。

這意味著,如果把此次深圳南坪交通事故中的場景交給其他自動駕駛公司去應對,很可能也無法成功避免交通事故。即使在這個場景中應對成功,但同樣的場景下,把大貨車換成一輛集裝箱車輛,近距離加塞時仍然有可能發生碰撞事故。

改進之路

在一些消費者看來,超車行為是道路上常見的真實場景,尤其是在城市裡面,加塞場景更需要被處理好。否則,只能說明自動駕駛還不完善。而大家更關心的是,如果車企的自動駕駛系統確實無法處理所有的場景,便應該明確告知消費者它的自動駕駛功能的局限性。

Model 3 車主劉先生回憶,在買這輛車時,「特斯拉的工作人員跟我說,花 5.6 萬就可以(讓車輛)具備完全自動駕駛能力……因為相信它,我才願意花 5.6 萬。風險方面,他一點也沒告訴我,沒告訴我不能識別雪糕筒,也沒告訴我不能識別大貨車。」

正是因為 Autopilot 提供駕駛便利,車主會信任它。但又因為系統不成熟,在遇到 Autopilot 無法解決的情況時,又存在車主無法及時接管車輛的可能性。這就到了考驗人性和駕駛員經驗的時刻,人類駕駛員既不能完全信任Autopilot,又要利用它來完成某些路段的自動駕駛任務。

那麼,如何完善自動駕駛功能?

有業內人士建議,可以從感測器方面,嘗試增加角雷達來進行提高感知能力等。此外,在自動駕駛尚未完全成熟之前,自動駕駛測試進行得多麼充分,都無法窮盡現實道路中的所有場景。再加上中國道路的複雜性和國人的交通習慣,特斯拉或許應該在算法層面更加保守,同時要更加註重對人類駕駛員的教育和宣傳。

畢竟,特斯拉Autopilot 已經不是一件普通意義上的商品,它處於不斷迭代更新的過程中,而且是一場由車企和消費者共同參與的技術迭代之旅。所以,在更高級別自動駕駛到來前,駕駛員仍需要克服人性對機器的依賴,掌握駕駛的主導權。

《車雲》授權

【延伸閱讀】

勞斯莱斯的野心:遠洋無人船以及背后的黑科技_-.png)