輝達 2025 年 Q4 財報

當 DeepSeek- V3 和 R1 模型在矽谷掀起驚濤駭浪時,人們認為如果低成本都能打造高性能模型,那麽依靠昂貴 GPU 堆砌算力的效果將大打折扣。

然而,輝達(NVIDIA, NVDA-US)不僅屹立不倒,反而展現出更強的生命力。

剛剛發布的財報數據顯示,輝達第四財季營收為 393.31 億美元,較上年同期成長 78% 。 2025 財年全年營收 1,305 億美元,較 2024 財年成長 114% 。

H20 晶片的訂單激增,Blackwell 平台的前景一片光明,更多高效模型的出現也點燃了對 AI 基礎設施更加旺盛的需求。而輝達的 GPU 依然是這一領域的首選。

以下為本次輝達財報重點:

- 創紀錄的季度營業收入 393 億美元,比去年同期成長 78 %,較前期增加 12%,超出市場預期的 381 億美元

- 創紀錄的數據中心季度營業收入 356 億美元,比去年同期成長 93 %

- 創紀錄的全年營業收入 1,305 億美元,比去年成長 114 %

- 數據中心貢獻 1,152 億美元,比去年同期增長 93%,佔整體營收占比 88%

- Blackwell 在首個季度便貢獻 110 億美元,是輝達有史以來成長最快的產品

- 2025 財年 Q4 淨利潤為 220.9 億美元,比去年同期增長 80%,較前期增長 14%;全年淨利潤為 728.8 億美元,較去年增長 145%

- 2025 財年 Q4 毛利率為 73%,略低於市場預期的 73.5%,較前期下降 1.6%;全年則為 75%

2026 年 Q1 財測

整體來看,此份財報的表現依然是一份積極上漲、超出預期的年終成績。不過由於DeepSeek- R1 是在 2024年 1 月下旬發布,並沒有影響到這份財報的指標。

DeepSeek- R1 真正給輝達帶來的影響,還要看 2026 財年第一季度的業績情況,輝達已給出指引:

- 預計營業收入為 430 億美元,上下浮動 2%

- 預計 GAAP 毛利率將延續下滑基調,降至為 70.6%

同時也宣布輝達 GTC 大會黃仁勳的演講時間為台灣時間 3 月 19 日星期三的淩晨,並提前鎖定三個關鍵詞:

Agent,機器人,加速計算。

與前兩年的關鍵詞「AI、 雲技術、元宇宙/數位孿生」相比,更加聚焦於細分領域。

Test-Time Scaling 引爆 AI 新戰場

業界普遍認為,Scaling Law 並沒有完全失效,只是 Scaling 的方向正在發生變化,隨之而來的則是,AI 產業逐漸走向了另一條分叉口——Test-Time Scaling。

Test-Time Scaling 主要用於推理階段,通過分配額外的計算資源來優化模型的推理性能。

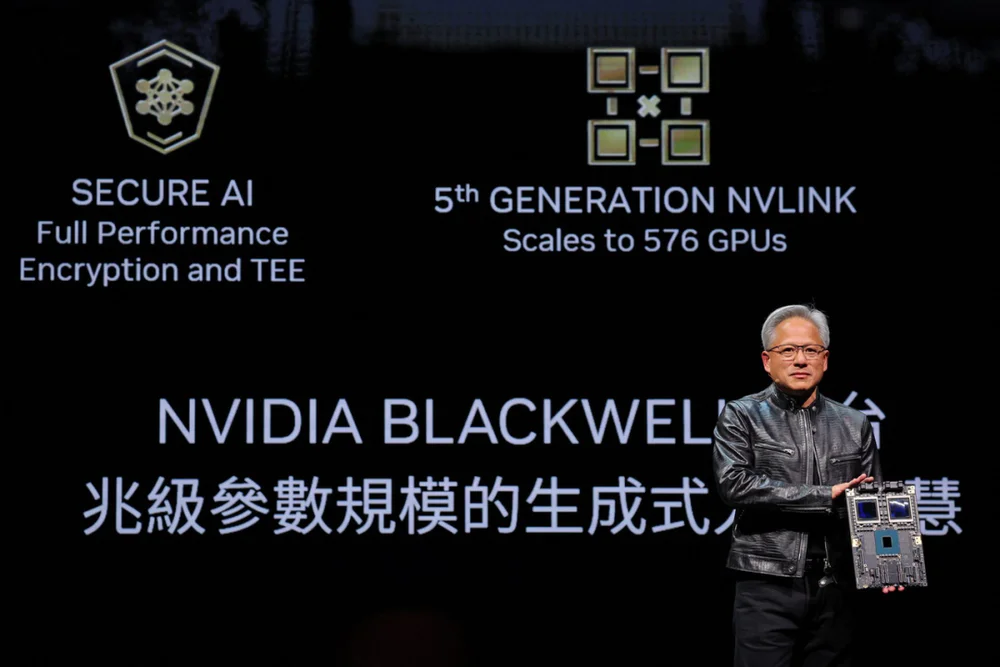

輝達的 Hopper 架構和 Blackwell 架構都能顯著提升模型推理的效率。其中 Blackwell 系列更是被寄予厚望,能夠為 Test-Time Scaling 提供強大的硬體支持。

黃仁勳在今天財報的新聞稿表示:

我們已成功大規模量產 Blackwell AI 超級電腦,並在首個季度實現了數十億美元的銷售額。隨著自主智能體 AI(Agentic AI)和物理 AI 的發展,AI 正以光速推進,為下一波 AI 革命奠定基礎,重塑各大核心產業。

Blackwell 晶片架構亮相於去年的 GTC 2024 開發者大會,以美國數學家 David Blackwell 命名,旨在支持大規模 AI 模型的訓練和推理,具備高性能和高效率的特點。

但這款今天被黃仁勳譽為「在各個方面都表現非凡」的晶片,卻在投產過程中一波多折。

據悉,Blackwell 晶片在設計上存在重大缺陷,特別是在連接兩個 GPU 的關鍵電路上,導致良品率較低。在高密度伺服器機架中,Blackwell 晶片也會因散熱不足導致過熱,影響性能並可能損壞硬體。

好在,後續在台積電的幫助下,輝達修覆了設計缺陷。談及在早期生產 Blackwell 時遇到的「小問題」時,黃仁勳表示,「這可能讓我們損失了幾個月的時間。」

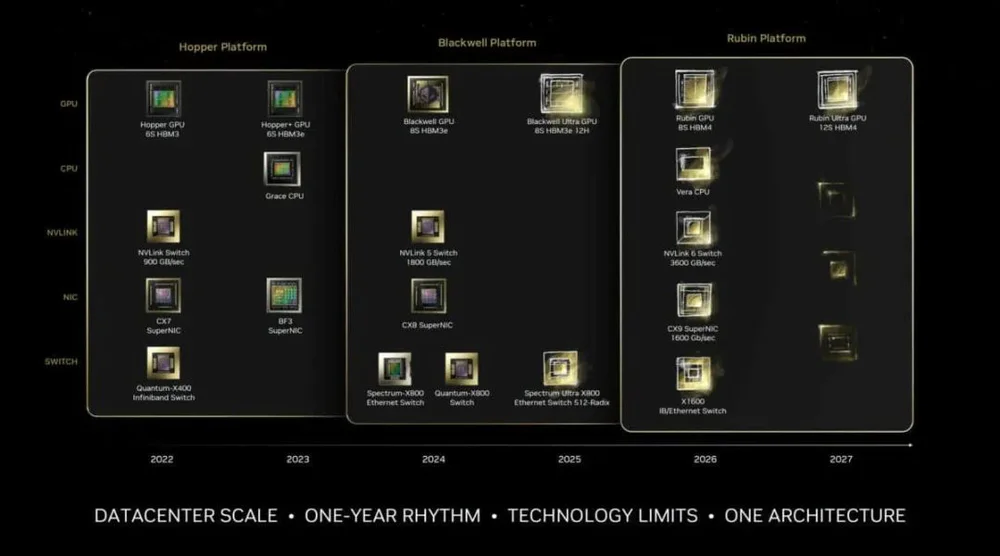

不過,他補充道,公司「以光速」恢復,並從中吸取了經驗,為 Blackwell Ultra( B300 系列)的生產做好了準備。他表示,「下一班火車」將按照「每年的節奏」推進。

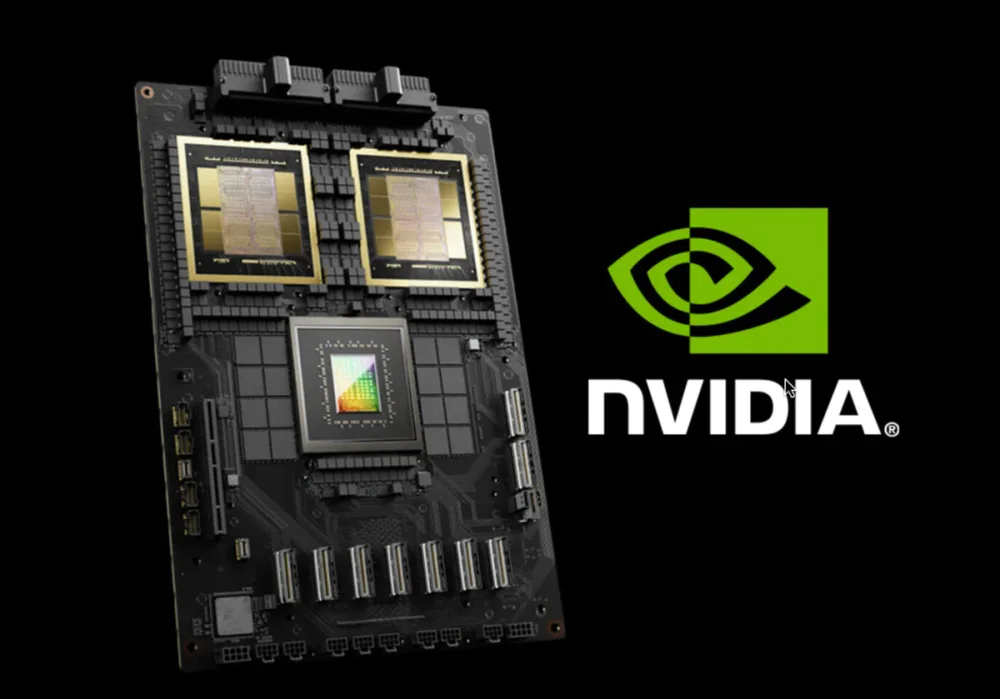

Blackwell Ultra 是輝達下一代重要的 AI 晶片,這款晶片在技術規格上實現了顯著提升,特別是在推理性能、顯存容量和頻寬方面,並引入先進的冷卻技術。

其不僅配備 288GB HBM3E 顯存,顯存容量相比 B200 的 192GB 提升,顯存頻寬達到 1,792 GB/s,功耗也達到了 1,400W ,按照輝達的路線圖,預計將在今年下半年推出。

談到 Blackwell 的過渡,黃仁勳表示:「這是一次非常具有挑戰性的轉變。」但他預計,未來向 Blackwell Ultra 的過渡會更加順利。

他解釋說,Blackwell Ultra 的過渡更平穩,因為其晶片架構與 Blackwell 相同。而相比之下,從 Hopper 過渡到 Blackwell 的挑戰要大得多。

黃仁勳指出,AI 晶片最好被視為軟體——它將無處不在,遍布每個國家和地區。「每個學生都會使用 AI 作為導師,」他補充道:「沒有一家金融科技公司不會使用 AI。」

基於此,市場對 Blackwell 的需求更是驚人的,推理 AI 引入了另一條 Scaling Law——增加訓練計算量可以讓模型更智能,而增加長期思考的計算量則能讓答案更精準。

輝達 CFO Colette Kress 也認為,推理需求正在「加速」。

在 Test-Time Scaling 以及 OpenAI o3 、DeepSeek R1 和 Grok 3 等新推理模型的推動下,後訓練和模型定制的規模巨大,總體上需要數量級更高的計算加速。

除此之外,受美國出口管制的影響,輝達為中國市場推出了特供版 H20 晶片。

這款晶片性能雖不及 H100 或 H200 ,但在合法性與 CP 值上表現出色。尤其是其在 DeepSeek 模型上的良好表現吸引了眾多企業的關注,導致訂單在近期出現了「顯著成長」。

不過,Kress 在財報電話會議上表示,公司的中國數據中心收入「遠低於正常水平」。她指出,該收入水平是在監管法規變化之前的情況,並預計中國的出貨量將「基本維持在目前比例」。

她還表示,由於 Blackwell 產能的快速提升,美國的數據中心收入最為強勁。

在過去幾個月,全球 AI 基礎設施投資熱潮已然形成燎原之勢,美國科技巨頭在 AI 領域的投資預算近日也陸續公布,得益於目前輝達在 GPU 市場的優勢地位,預計不少預算將被收入囊中。

- Meta 計劃投資超過 2,000 億美元建設新一代 AI 數據中心園區。

- OpenAI 與軟銀(SoftBank Group Co, 9984-JP )等聯合啟動「Stargate」計劃,未來四年內投資 5,000 億美元建設 AI 數據中心。

- 微軟(Microsoft, MSFT-US)計劃在 2025 財年投入約 800 億美元用於 AI 數據中心建設。

- Google 計劃在 2025 年投入約 750 億美元用於 AI 數據中心和相關基礎設施。

- 亞馬遜(Amazon, AMZN-US)計劃在 2025 年投入超過 1,000 億美元,主要用於雲端運算和 AI 技術的研發。

輝達看似獨占鰲頭,卻也面臨挑戰。

一方面,正如黃仁勳所說,儘管輝達製造了很多晶片,但這並不意味著它們會被公司購買,以及部署,他表示,作出商業決策時需要考慮其他因素。

他還提到,輝達能夠繼續取得成功並保持強勁的需求,原因之一是該公司「部署能力快如閃電」以及其持續創造更先進的技術。

另一方面,據外媒 The Information 援引 Arm CEO Rene Haas 的說法,儘管輝達在已部署基礎設施上占據絕對優勢,但晶片新創企業同樣正在推動諸多創新,比如光纖基板、共同封裝光學器件、革命性內處理器架構以及內處理器計算等。

半導體產業正迎來一個非常有趣的時代,畢竟多年來這一領域的創新相對有限。

DeepSeek 讓輝達市值暴跌?或許只是障眼法

春節期間 DeepSeek 在矽谷的爆火出圈,也給輝達的發展增添了新的變量。

通過算法創新、數據壓縮和推理優先的設計,DeepSeek 以極低的訓練成本,打造出高性能模型 DeepSeek- V3 / R1 ,引發了一連串的連鎖反應。

常規的看法是,受到 DeepSeek 的衝擊,輝達的市值一度在一天內暴跌了 5,890 億美元。

但 DeepSeek不僅沒有削弱「算力至上」的邏輯,反而在某種程度上進一步強化了這一信仰,尤其是 DeepSeek 模型的訓練過程仍舊依賴於輝達 H800 晶片集群,而這也是常被市場忽視的關鍵事實。

黃仁勳上週接受採訪時也表示,儘管 DeepSeek 確實在預訓練模型方面取得進展,但後訓練階段仍需要龐大算力;後訓練才是培養 AI 模型智力、即學習如何解決問題和推理的最關鍵環節。

包括 DeepSeek 這幾天連續開源多個輝達 GPU 優化項目,在探索模型性能極限之餘,也進一步加深了其與輝達生態的綁定。

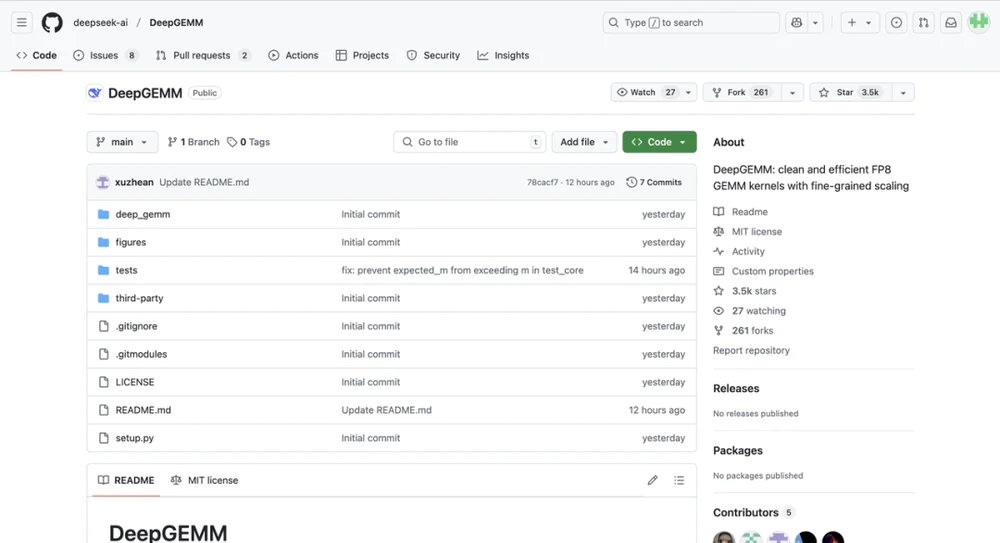

比方說,昨天開源的 DeepGEMM 是一個高效、簡潔的 FP8 矩陣乘法(GEMM)庫。

其採用的 Just-In-Time(JIT)設計、兩級累加以及高性能優化技術,如 TMA 和指令重疊,使其在DeepSeek- V3 中表現出色,但同時DeepGEMM也是專為輝達 Hopper 架構和稀疏專家模型(MoE)優化。

此外,當 DeepSeek 正在用開源切入輝達的市場,雙向奔赴的輝達也正在用生態整合 DeepSeek 的成果。

DeepEP 在上午開源後,輝達下午便將其集成到 Megatron-LLM 中。據消息指出(@共識粉碎機),輝達內部已將對 DeepSeek 的支持重要性提升至比 Llama 更高的優先級,內部資源和流程也是一路綠燈。

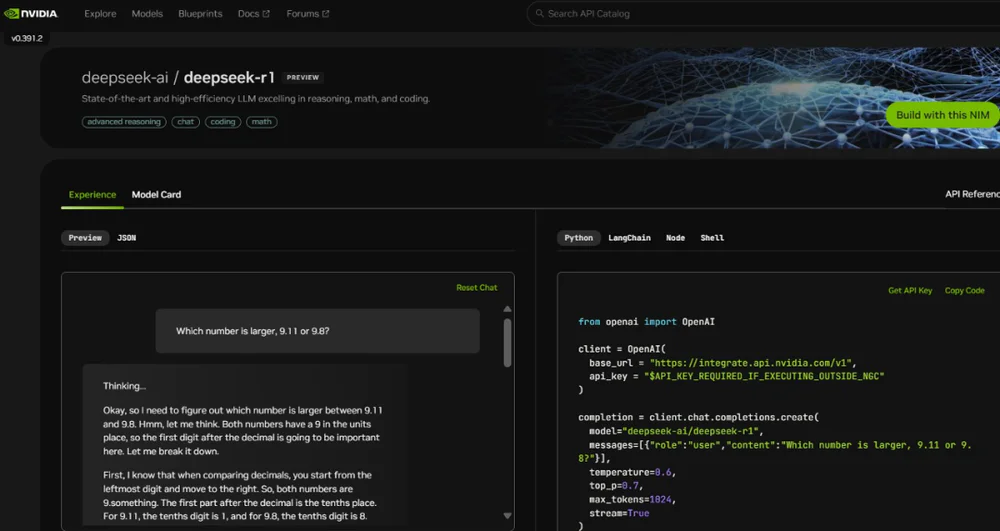

春節期間,關於 DeepSeek- R1 的 NVIDIA NIM 微服務的預覽版上線。

這意味著開發者可以在輝達的平台上測試和使用 DeepSeek- R1 模型,結合 NVIDIA AI Foundry 和 NVIDIA NeMo 軟體,企業還可以定制 DeepSeek- R1 NIM 微服務,以構建特定領域的 AI 應用。

輝達近期更是開源了專為 Blackwell 架構優化的 DeepSeek- R1 版本。該版本在推理處理速率提升至原來的 25 倍,同時每個 token 的計算成本僅為先前的 1 / 20 。

從機遇角度看,DeepSeek 的開源正在為輝達帶來前所未有的市場紅利。

黃仁勳在電話會議中也提到,「DeepSeek R1 點燃了全球的熱情」。短期內,開源引發的算力熱潮直接推高了 GPU 銷量。

長期來看,開源社區的活躍將進一步鞏固輝達的生態優勢,開發者對 CUDA 的依賴只會加深,而企業客戶在追求更高性能時仍會選擇 Blackwell 等新品。

最底層的邏輯是,低成本模式適用於消費級應用,但在企業級 AI(如 AGI 研發)中,輝達的高端晶片仍是不可替代的。未來,AI 產業可能走向「雙軌制」,低階市場追求 CP 值,高端市場繼續依賴算力驅動。

開源是 AI 的催化劑,但催化劑需要強大的硬體承載,輝達正是那個承載者。

用一句更形象的話概括,當全世界都在擔心 DeepSeek 會成為輝達的掘墓人時,黃仁勳卻在背後悄悄給它遞了把鏟子:

不是用來挖墳,而是一起挖金礦。

【延伸閱讀】