毫無疑問,在目前的 AI 市場,輝達(NVIDIA, NVDA-US) (Nvidia) 可謂是“春風得意馬蹄疾”。憑藉性能強大的 GPU 運算卡,輝達在目前的 AI 硬體市場佔據著絶對龍頭的地位。去年,輝達的股價更是上漲了三倍多,足見市場對於輝達的看好。但是在這一片繁榮的背後,輝達的盛世危機也或將來臨。

輝達的“顯示卡盛世”

1993 年 4 月,從整合電路生產商 LSI Logic 出來的黃仁勛,聯合 Sun 公司兩位年輕工程師 — Chris Malachowsky 和 CurTIs Priem 共同創立了輝達,他們的初衷是研發一種專用晶片,用來加快電子遊戲中 3D 圖象的渲染速度,帶來更逼真的顯示效果。

最初幾年,由於技術上的優勢,輝達發展頗為迅速。

1999 年 1 月,輝達全年營收就突破了 1.5 億美元,並在納斯達克掛牌上市。同年 5 月,其圖形處理器銷量超過 1000 萬。8月,輝達推出第一款以 GeForce 命名的顯示核心 — GeForce 256,並首次提出 GPU 概念。2000 年年底,輝達以 7000 萬美元現金、100 萬股公司股票,將 3Dfx 收入囊中,正式成為行業老大。

此時的 GPU 市場,只剩一家競爭對手可與輝達匹敵,那就是 ATI 。然而,在經過多年的雙強並立期之後,輝達開始盛極轉衰。2000 年,為了進軍遊戲主機行業,微軟(Microsoft, MSFT-US)找到了如日中天的輝達,請他們研發 Xbox 圖形晶片、SoundStorm 聲音晶片以及主板解決方案。這本是輝達一個再次發展的絶好機會,但事與願違。

在合作過程中,雙方因交付價格問題產生矛盾,二者甚至鬧到了啟動法律仲裁的程度。最終,微軟把訂單交給了輝達的競爭對手 ATI 。

這次合作的失敗讓輝達遭受了沉重的打擊,不僅 2003 年營收減少,還錯過了微軟 DirectX 9 規格確立的重要消息,直接導致當年推出的 GeForce FX 由於兼容性問題敗給 ATI 的 Radeon 9700。在與微軟合作失敗的同時,英特爾(Intel, INTC-US) 也開始扶持 ATI 。

面對如此嚴峻的局面,輝達開始尋求走出困境之道。主動與微軟和解,爭取再次合作;同時和英特爾達成了專利交叉許可協議。此後幾年,輝達的鋒芒有所收斂,發展也比較平穩,公司的業績也穩步成長。

不料,天有不測風雲。2008 年,輝達遭遇了公司成立以來最大的挑戰。在這一年, CPU 巨頭 AMD 收購輝達老對手 ATI ,形成了 CPU 整合 GPU 的新解決方案。屋漏偏逢連夜雨,與此同時,英特爾也終止了與輝達的合作,在其晶片集中整合了 3D 圖形加速器。

無奈之下,輝達只得走高性能獨立顯示卡一條路,但卻遭遇質量問題。這一年,輝達股票暴跌,從 37 美元跌到 6 美元左右,營收大跌 16%。

之後兩年,輝達在市場上進入蟄伏期,表現不溫不火,卻也平穩。隨著智慧手機市場以及平板電腦市場火爆,輝達也開始進軍行動市場,迎來了又一個“盛世”。

輝達的“行動盛世”

在從單核心到雙核心安卓智慧手機的過渡中,2010 年輝達率先發佈了 Tegra 2 雙核 (Cortex-A9) 晶片,主攻智慧手機市場,並且獲得摩托羅拉(Motorola Solutions, MSI-US) (Motorola) 的選用。而當時的高通(Qualcomm, QCOM-US) (Qualcomm) 還主要是一家提供基帶的廠商,聯發科(2454-TW)也還沒進入智慧手機市場,對於輝達來說,整個行動領域市場機會非常巨大。

2011 年 11 月輝達又推出了全球首款行動四核心處理器 Tegra 3,這款晶片也獲得了眾多智慧手機廠商和平板電腦廠商的採用。比如 HTC One X,微軟的第一代 Surface RT 平板電腦等。

為了加碼智慧手機市場,2011 年,輝達還斥資 3.67 億美元收購 Icera 的調製解調器業務。2013 年 1 月的 CES 展上,輝達推出了新一代智慧手機晶片 Tegra 4,仍為四核晶片,但是採用了“4+1”的設計,即具備四顆主核心和一顆省電核心。這款晶片隨後也被小米 3,微軟的 Surface 2 改採用。

隨後輝達開始將 Tegra 晶片業務延伸到了汽車領域,特斯拉(Tesla, TSLA-US) Model S 電動車的車載娛樂系統也是基於 Tegra 3 設計。此次業務延伸可謂相當成功。根據輝達公佈 2013 年財年的業績報告顯示,Tegra 業務年收入高達 7.64 億美元,營業利潤近 4000 萬。不過,那已經是 Tegra 晶片業務的高峰期了。而輝達在行動市場轉向衰落的開始,似乎正式始於 Tegra 4i 晶片的推出。

2013 年 2 月 19 日,輝達發佈了 Tegra 4i 晶片,作為 Tegra 4 系列的一員,首次整合了輝達的 i500 LTE 調製解壓器。但是這款晶片推出之後卻遭遇了市場冷遇,沒有獲得客戶採用。與此同時,高通、聯發科等競爭對手的整合基帶的處理器不斷的在智慧手機市場攻城略地。此後,輝達便開始逐漸淡出行動市場。

雖然,之後輝達有推出 Tegra K1 和 Tegra X1 兩款性能不錯的晶片,Tegra X1 也有被 Google 的 Pixel C 平板改採用,但是此時輝達的主要目標市場似乎已經不是行動設備了,而是轉向遊戲和汽車領域。

2014 年 5 月,輝達 CEO 黃仁勛在接受媒體採訪時宣佈,輝達已經決定撤離智慧手機市場。2015 年,輝達宣佈停止推出新款 LTE 調製解調器。至此,輝達正式退出了行動市場。

雖然此後輝達開始全身心專注於汽車領域,包括專業定製兩種不同的 Tegra 車載平台 Drive CX 和 Drive PX,前者主攻車載娛樂顯示螢幕,後者是先進的輔助駕駛功能。

當時,在道路上跑的汽車有超過 800 萬輛搭載 Tegra 晶片,還有 25 萬在(4543-TW)流水線生產中,但實際上是 Tegra 晶片業務量相比一年前的更少了,甚至是無利可圖。

對於退出行動市場的原因,輝達認為是高通把自己逼走的。為此,2016 年輝達還將高通告上了法庭。輝達在法庭文件中指出,是高通“非法濫用其壟斷地位”,導致自己“客戶訂單出現莫名其妙的延遲,市場需求大減,很多與客戶的合約也無法按時簽署,即便是有客戶表達了強烈的購買意願也無法成行”。

輝達的“AI 盛世”

其實早在 2012 年,輝達就已經開始佈局人工智慧。這一年,多倫多大學 Alex Krizhevsky 創建了能夠從 100 萬樣本中自動學習識別圖象的深度神經網絡。僅在兩塊 NVIDIA GTX 580 GPU 上訓練幾天,“AlexNet”就贏得了當年的 ImageNet 競賽,擊敗了磨練幾十年的所有人類專家算法。同年,認識到網絡規模越大、或者大腦越大,其學習能力就越強的規律之後,史丹佛的 Andrew Ng 與輝達研究室合作開發了一種使用大規模 GPU 運算系統訓練網絡的方法。

2015 年輝達在 CES 前夕發佈了面向汽車自動駕駛的 Drive PX 專用運算平台 (基於 2 顆Tegra X1 處理器) ,並被不少汽車廠商改採用。

2016 年初,隨著 AlphaGo 大敗圍棋世界冠軍李世石,人工智慧概念大熱,各類人工智慧產品也迎來了爆發。眾多的科技巨頭也紛紛在人工智慧領域投下了重注。而人工智慧之所以能夠爆發,也離不開硬體的發展,特別是 GPU 技術的進步。相對於 CPU 來說, GPU 在並行運算上更快、更便宜、更有效,更適合於人工智慧在深度學習方面的訓練。

顯然,這對於全球顯示領域的巨頭輝達來說確實是一個巨大的機遇。因此,此前在行動市場遭遇挫折的輝達也開始全面轉向人工智慧領域。輝達憑藉其累積的 GPU 技術優勢,也迅速佔據了人工智慧市場的優勢。

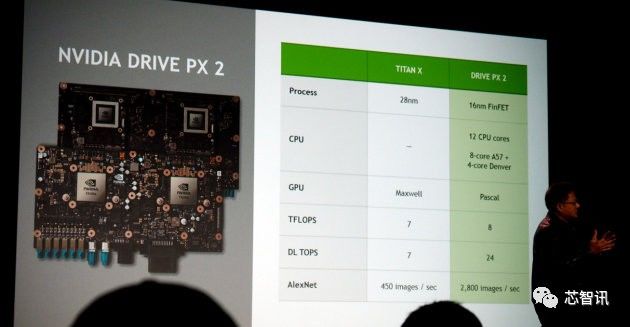

在 2016 年 CES 上,輝達又推出了 Drive PX 2 車載電腦,號稱自動駕駛汽車中全球首款智慧超級電腦。這塊產品隨後也被眾多的汽車廠商改採用。成為了提振股價的一大助力。

2016 年 9 月底,Nvidia推出了一款專為無人駕駛汽車設計的新一代人工智慧超級電腦平台 — Xavier。可實現人機交互、深度學習、自動駕駛等功能。

今年 CES 上,全球汽車零件巨頭采埃孚 (ZF) 宣佈與輝達合作,共同為自動駕駛的乘用車、商用車以及其他工業機器人應用開發了全新的人工智慧系統 — Pro AI 。與此同時,Nvidia 推出了人工智慧協同駕駛系統 AI Co-Pilot。這套系統最大的亮點是,此前的自動駕駛技術多數是基於自適應巡航系統,依靠前期輸入的地圖和數據訊息進行半自動駕駛;而這套系統,車輛可以通過攝像頭實時採集訊息,掃瞄周圍道路街景、車輛、行人、路標等經由 GPU (圖形處理器) 分析處理,可以說完全具備了自己學習能力。

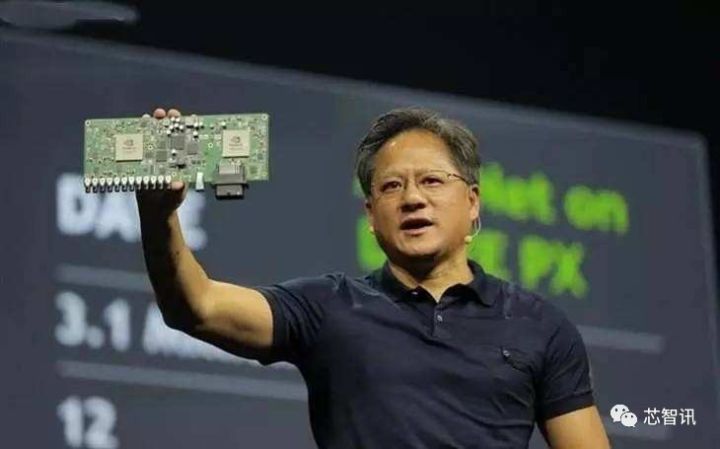

今年的 CES 更是請 Nvidia 的黃仁勛作為開幕前夜最重頭的專場演講的嘉賓,而以往這都是被微軟、英特爾等巨頭包攬的。在開幕演講當中,輝達 CEO 黃仁勛也不止一次的提到“我們是一家人工智慧公司”。

憑藉著人工智慧火爆的勢頭,去年輝達的股價更是上漲了三倍,今年目前相比去年也已上漲了 70% 多。確實令人驚訝!

同時,Nvidia 的營收也是一路上漲,根據 Nvidia 此前發佈的截至今年 4 月 30 日的 2018 財年第一季度財報顯示,Nvidia 第一財季營收為 19.37 億美元,較上年同期的 13.05 億美元成長 48%。淨利潤為 5.07 億美元。

今年 5 月,輝達在美國舉辦 2017 GTC,又推出了新款 GPU Tesla V100 以及 DGX-1 超級電腦、HGX-1 雲服務器以及 ISSAC 機器人訓練平台等眾多新品。引起了業內的廣泛關注。

今天,輝達 GTC China 開發者大會在北京舉行。與之前在美國的 2017 GTC大會相比,輝達在此次 GTC China上並沒有發佈任何硬體產品。只推出了 TensorRT 3 人工智慧推理軟體。據介紹,TensorRT 3 可與 GPU 硬體結合,可以大幅提升雲端及終端設備的推理性能,並有效降低成本。

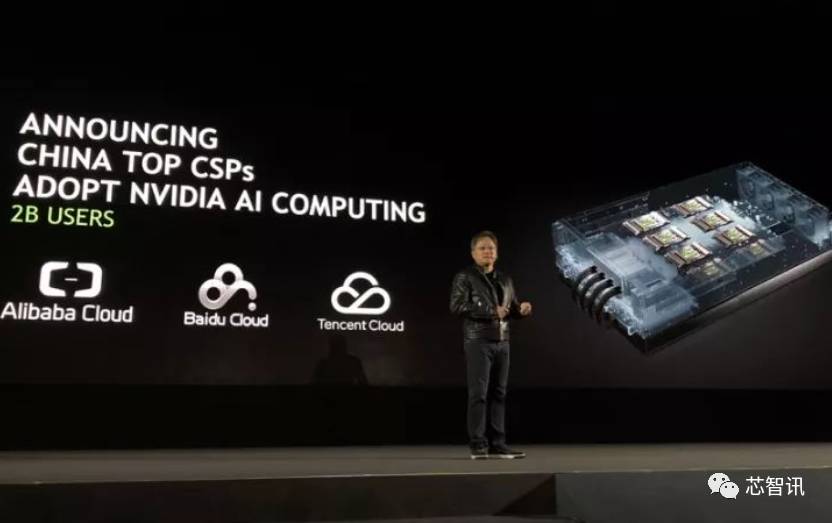

此外,黃仁勛介紹了其產品在中國市場的進展,阿里巴巴(Alibaba, BABA-US)、百度(Baidu, BIDU-US)、騰訊均已在其雲端人工智慧基礎設施上部署了輝達的 Tesla V100 GPU ,而華為、浪潮、聯想也已經作為 OEM 廠商,開始生產基於 HGX 的 GPU 服務器。TensorRT 3 目前已被阿里雲、百度雲、騰訊、科大訊飛和京東採用。另外,阿里巴巴、海康威視、大華(9905-TW)和華為則加入了輝達 Metropolis 平台,並分別在路況監測、虛擬安保、交通流量監測等方面提供了基於該平台的人工智慧影音解決方案。

黃仁勛在會上也意氣風發的表示,“摩爾定律已經是舊時代的法則, GPU 的運算速率和神經網絡複雜性都在過去 2-5 年內呈現出爆發性成長,二者結合後,我們將看到來自醫藥、自動化交通、精密製造、乃至更多領域的驚人突破。”

而就在一週之前的“英特爾精尖製造日”活動上,英特爾還宣佈摩爾定律繼續有效,並且在未來十年內繼續有效。黃仁勛此番言論自然也引發了業內的熱議,被認為是在向英特爾挑釁。而黃仁勛的底氣來自於輝達目前在人工智慧市場的強勢地位。

但是,在輝達“ AI 盛世”的背後,也隱藏著不小的危機。

輝達的第三次盛世危機?

人工智慧的概念確實很熱,目前有很多廠商採用原有的 CPU 、 GPU ,或者 DSP 來進行人工智慧運算,但是相對而言,神經網絡處理器更適合人工智慧。

神經網絡處理器比 GPU 更適合人工智慧?

從技術角度看,包括深度學習在內的人工智慧實際上是一類多層大規模人工神經網絡。它模仿生物神經網絡而構建,由若干人工神經元結點互聯而成。神經元之間通過突觸兩兩連接,突觸記錄了神經元間聯繫的權值強弱。每個神經元可抽象為一個激勵函數,該函數的輸入由與其相連的神經元的輸出以及連接神經元的突觸共同決定。為了表達特定的知識,使用者通常需要 (通過某些特定的算法) 調整人工神經網絡中突觸的取值、網絡的拓撲結構等。該過程稱為“學習”。在學習之後,人工神經網絡可通過習得的知識來解決特定的問題。

由於神經網絡運算的類型和運算量與傳統運算的區別,導致在進行神經網絡運算的時候,相比傳統 CPU 、DSP甚至 GPU 都有算力、性能、能效等方面的不足,所以激發了專為神經網絡運算而設計處理器或加速器的需求。

在此前由芯智訊主辦的《2017生物識別技術與應用高峰論壇》上,高通 (中國) 產品市場資深經理劉學徽先生就透露,雖然現在的手機晶片裡的 CPU 、 GPU 、DSP 都可以做人工智慧運算,但是同樣的一個算法在 GPU 上速度要比 CPU 快4倍,如果在 DSP 上則要比 CPU 快 8 倍。在能效方面, GPU 運算要比 CPU 節省 8 倍,DSP 則可節省 25 倍。而如果運算在專門針對人工智慧的神經網絡處理器上,無疑將會更快。

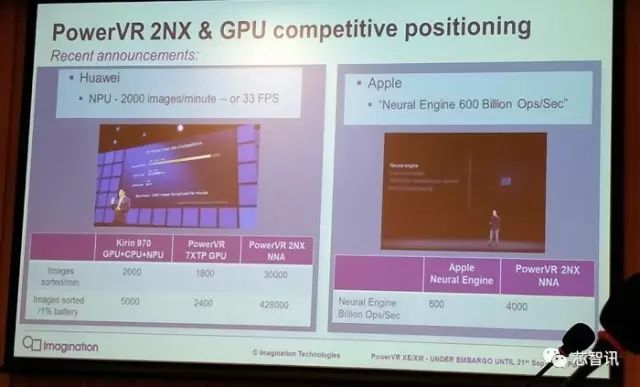

9 月 21 日,Imagination 發佈了一款針對行動市場的神經網絡處理器 PowerVR 2NX NNA,通過 Imagination 給出的數據對比我們可以看到。其上一代的 PowerVR 7XTP GPU 相比,PowerVR 2NX NNA 的人工智慧性能要高 17 倍左右,同時能耗要低約 178 倍。

顯然,神經網絡處理器在人工智慧方面確實要比 GPU 要更有優勢。而這也正是輝達的未來的一個危機所在。

雖然,輝達在最新的圖形晶片架構中加入了專門的 Tensor Cores 運算核心。Tensor Cores 針對利於深度學習操作的數學運算進行了優化,輝達的 GPU 越來越像專業的 AI 處理器了,而不僅僅是用於生成圖形的工具。但 GPU 終歸還是 GPU 。

人工智慧晶片創業公司 Cerebras Systems 的聯合創始人兼 CEO Andrew Feldman 此前在接受采時也認為,“輝達最大的問題在於, GPU 是為生成圖形而非處理 AI 算法所設計的。我不認為 GPU 很適合機器學習,它只是比英特爾的 CPU 更好而已。”

所以,我們也看到,目前眾多的人工智慧晶片公司都在積極研發基於神經網絡的處理器。除了前面提到的 Imagination 之外,還 Google 、英特爾、IBM 等廠商都在這個方向上深耕多時。

今年 4 月, Google 資深硬體工程師 Norman Jouppi 就曾表示, Google 的專用機器學習晶片 TPU 處理速度要比 GPU 和 CPU 快 15-30 倍 (和 TPU 對比的是 IntelHaswell CPU 以及 NVIDIA Tesla K80 GPU ) ,而在能效上,TPU 更是提升了 30 到 80 倍。此前打敗柯潔的 AlphaGo 就是基於 Google 的 TPU 處理器。

當然,TPU只是一個推理晶片,它並不能取代 GPU ,但是可以確定的是,它比 GPU 更適合人工智慧應用。

雖然英特爾在行動市場與輝達一樣也遭遇了失利,並且在 GPU 領域,英特爾也是落後於輝達,所以在針對人工智慧方面,英特爾此前也主要是依靠其 CPU 。不過,英特爾也在神經網絡處理器方面投入了重注。

2016 年 8 月,英特爾宣佈將以 3.5 億美元的價格收購了專門設計 AI 晶片的新創公司Nervan Systems。Nervana 主攻的就是基於神經網絡的深度學習方向。

隨後,英特爾開始研發基於 Nervana的 AI 平台和處理器。英特爾表示,和 GPU 解決方案相比,Nervana 在未來三年將把訓練一個深度學習模型的時間減少 100 倍。Nervana 具體產品是代號為 Lake Crest的 AI 處理器,在 2017 年上半年進行測試,預計將產生突破性的性能,並大幅減少訓練複雜神經網絡所需時間。

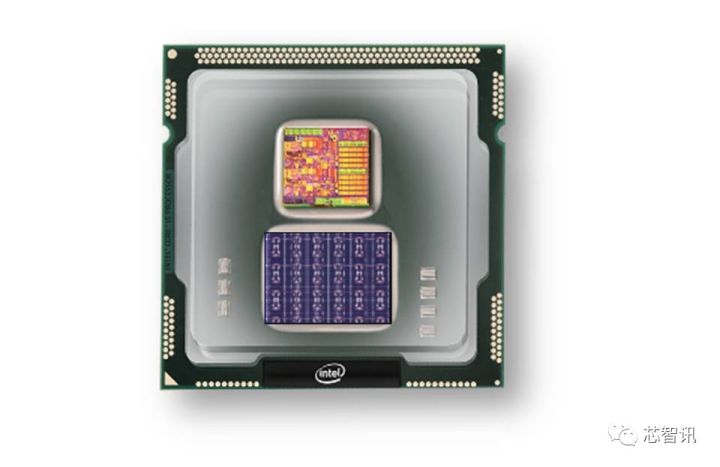

另外,就在今天黃仁勛嘲笑英特爾“摩爾定律已經是舊時代的法則”的同時,英特爾實驗室今天正式公佈了代號威“Loihi”的自學習神經元晶片,並稱其可模仿大腦的功能,能從環境反饋中直接學習。

據介紹,“Loihi 晶片由 128 個運算核心組成,每個核心有 1024 個人工神經元,整個晶片共有超過 13 萬個神經元和 1.3 億個突觸連接。從神經元數量上看,人腦則由超過 800 億個神經元構成,顯然這個晶片距離模擬人類大腦的內部的複雜行為還很遙遠。”但是,Loihi 晶片的複雜度已經超過了龍蝦的大腦,不得不說這也是一個巨大的進步。

英特爾稱 Loihi 晶片通過神經元之間的脈衝/spike 來傳輸數據。可以適應 Go 語言並使用它學習。目前最前沿的機器學習系統依賴於需要大規模數據和大量算力的深度學習,而 Loihi 晶片完全不需要那些緊張而集中的學習過程,並且可以自主學習 (self-learning) 。

英特爾聲稱,通過模擬神經元的刺激模式,該晶片比起傳統的晶片設計,運行效率更高。“大腦並不像你所想的那樣頻繁溝通”,Intel 實驗室的高級首席工程師和首席科學家 Narayan Srinivasa 在採訪中說,“沒有神經刺激的時候,晶片是不需要耗能的。”

英特爾並沒有明確說明該晶片能有多高效運行,畢竟測試晶片還沒有準備好。但英特爾模糊的宣稱,該晶片的能耗只有通常用於訓練人工智慧系統晶片的千分之一。

據透露,Loihi 晶片的第一代測試晶片預計 11 月推出,基於英特爾 14nm 工藝。計劃 2018 年上半年面市。

此外,IBM Research 也已經花了好幾年時間研究一種類似的模擬神經元的神經形態晶片,即 TrueNorth。“TrueNorth 晶片包含 4096 個核以及 540 萬個晶體管,只需要 70 毫瓦的能耗。該晶片模擬了一百萬個神經元和 2 億 5600 萬個突觸,比起英特爾的第一代 Loihi 測試晶片的規模可大多了。”據介紹,TrueNorth 大概能模擬一隻蜜蜂的大腦。

除了面對來自人工智慧晶片廠商的挑戰之外,輝達還將面臨人工智慧正在向終端側轉移的劇變。

在此前芯智訊的多篇文章當中,我們都有提到,相對於雲端的人工智慧來說,在智慧終端側部署人工智慧在隱私保護、頻寬需求、低延時、功耗以及體驗等眾多方面都更有優勢。在智慧終端側部署人工智慧已經是大勢所趨。而目前智慧手機正是這樣一個需求最大的智慧終端市場。而面對這樣一個巨大的人工智慧市場,輝達目前似乎仍然只是一個旁觀者,而這樣的局面短時間內也難以改變。

另外在輝達強勢的自動駕駛市場,未來也將面臨英特爾的強力挑戰。今年 3 月,英特爾收購了在自動駕駛領域具有很大市場份額的 Mobileye。

從輝達過往的歷史來看,之前的已經歷了兩次的“盛極而衰”,在今天的“ AI 盛世”之下,面對未來危機,輝達能安然度過嗎?

《雪球》授權轉載

【延伸閱讀】